Un equipo de investigadores de ciberseguridad ha descubierto una técnica inteligente para inyectar de forma remota comandos inaudibles e invisibles en dispositivos controlados por voz, todo simplemente apuntando con un láser al dispositivo objetivo en lugar de usar palabras habladas.

Apodado ‘Comandos de luz‘el truco se basa en una vulnerabilidad en los micrófonos MEMS integrados en sistemas controlados por voz populares ampliamente utilizados que responden involuntariamente a la luz como si fuera sonido.

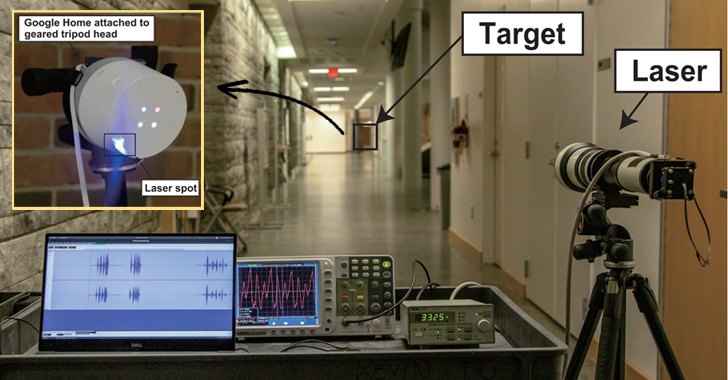

Según los experimentos realizados por un equipo de investigadores de las universidades japonesa y de Michigan, un atacante remoto que se encuentre a una distancia de varios metros de un dispositivo puede desencadenar el ataque de forma encubierta simplemente modulando la amplitud de la luz láser para producir una onda de presión acústica.

«Al modular una señal eléctrica en la intensidad de un haz de luz, los atacantes pueden engañar a los micrófonos para que produzcan señales eléctricas como si estuvieran recibiendo audio genuino», dijeron los investigadores en su artículo. [PDF].

¿No suena esto espeluznante? Ahora lee esta parte con atención…

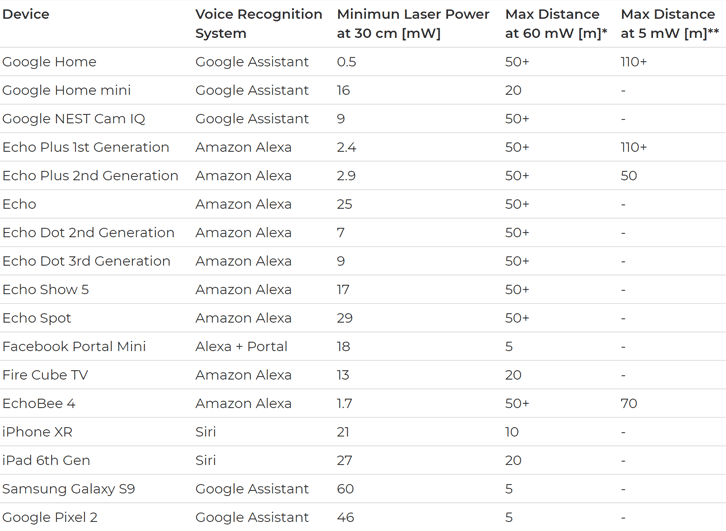

Los asistentes de voz inteligentes en sus teléfonos, tabletas y otros dispositivos inteligentes, como Google Home y Nest Cam IQ, Amazon Alexa y Echo, Facebook Portal, dispositivos Apple Siri, son todos vulnerables a este nuevo ataque de inyección de señal basado en luz.

«Como tal, cualquier sistema que use micrófonos MEMS y actúe sobre estos datos sin confirmación adicional del usuario podría ser vulnerable», dijeron los investigadores.

Dado que la técnica en última instancia permite a los atacantes inyectar comandos como un usuario legítimo, el impacto de dicho ataque se puede evaluar en función del nivel de acceso que tienen sus asistentes de voz sobre otros dispositivos o servicios conectados.

Por lo tanto, con el ataque de comandos ligeros, los atacantes también pueden secuestrar cualquier sistema inteligente digital conectado a los asistentes controlados por voz objetivo, por ejemplo:

- Controle los interruptores domésticos inteligentes,

- Abrir puertas de garaje inteligentes,

- Hacer compras en línea,

- Desbloquee y arranque de forma remota ciertos vehículos,

- Abra cerraduras inteligentes forzando sigilosamente el número PIN del usuario.

Como se muestra en la demostración en video que se detalla a continuación: en uno de sus experimentos, los investigadores simplemente inyectaron el comando «OK Google, abre la puerta del garaje» a un Google Home disparando un rayo láser al Google Home que estaba conectado a él y abrió con éxito un garaje. puerta.

En un segundo experimento, los investigadores emitieron con éxito el mismo comando, pero esta vez desde un edificio separado, a unos 230 pies de distancia del dispositivo Google Home objetivo a través de una ventana de vidrio.

Además de los dispositivos de mayor alcance, los investigadores también pudieron probar sus ataques contra una variedad de dispositivos de teléfonos inteligentes que usan asistentes de voz, incluidos iPhone XR, Samsung Galaxy S9 y Google Pixel 2, pero solo funcionan en distancias cortas.

El alcance máximo de este ataque depende de la potencia del láser, la intensidad de la luz y, por supuesto, tu capacidad de puntería. Además de esto, las barreras físicas (por ejemplo, ventanas) y la absorción de ondas ultrasónicas en el aire pueden reducir aún más el alcance del ataque.

Además, en los casos en que el reconocimiento de voz está habilitado, los atacantes pueden anular la función de autenticación del hablante mediante la construcción de la grabación de los comandos de voz deseados a partir de las palabras relevantes pronunciadas por el propietario legítimo del dispositivo.

Según los investigadores, estos ataques se pueden montar «fácil y económicamente», utilizando un puntero láser simple (menos de $ 20), un controlador láser ($ 339) y un amplificador de sonido ($ 28). Para su configuración, también usaron un teleobjetivo ($ 199.95) para enfocar el láser para ataques de largo alcance.

¿Cómo puedes protegerte contra la vulnerabilidad de la luz en la vida real? Los fabricantes de software deberían ofrecer a los usuarios agregar una capa adicional de autenticación antes de procesar los comandos para mitigar los ataques maliciosos.

Por ahora, la mejor y más común solución es mantener la línea de visión de los dispositivos de tu asistente de voz bloqueada físicamente desde el exterior y evitar darle acceso a cosas a las que no quieres que acceda otra persona.

El equipo de investigadores, Takeshi Sugawara de la Universidad de Electrocomunicaciones de Japón y el Sr. Fu, Daniel Genkin, Sara Rampazzi y Benjamin Cyr de la Universidad de Michigan, también publicaron sus hallazgos en un artículo [PDF] los lunes.

Genkin también fue uno de los investigadores que descubrió el año pasado dos importantes vulnerabilidades del microprocesador, conocidas como Meltdown y Spectre.